MMF - 视觉语言多模态研究框架学习资源汇总

833 2024-12-17 00:00:00

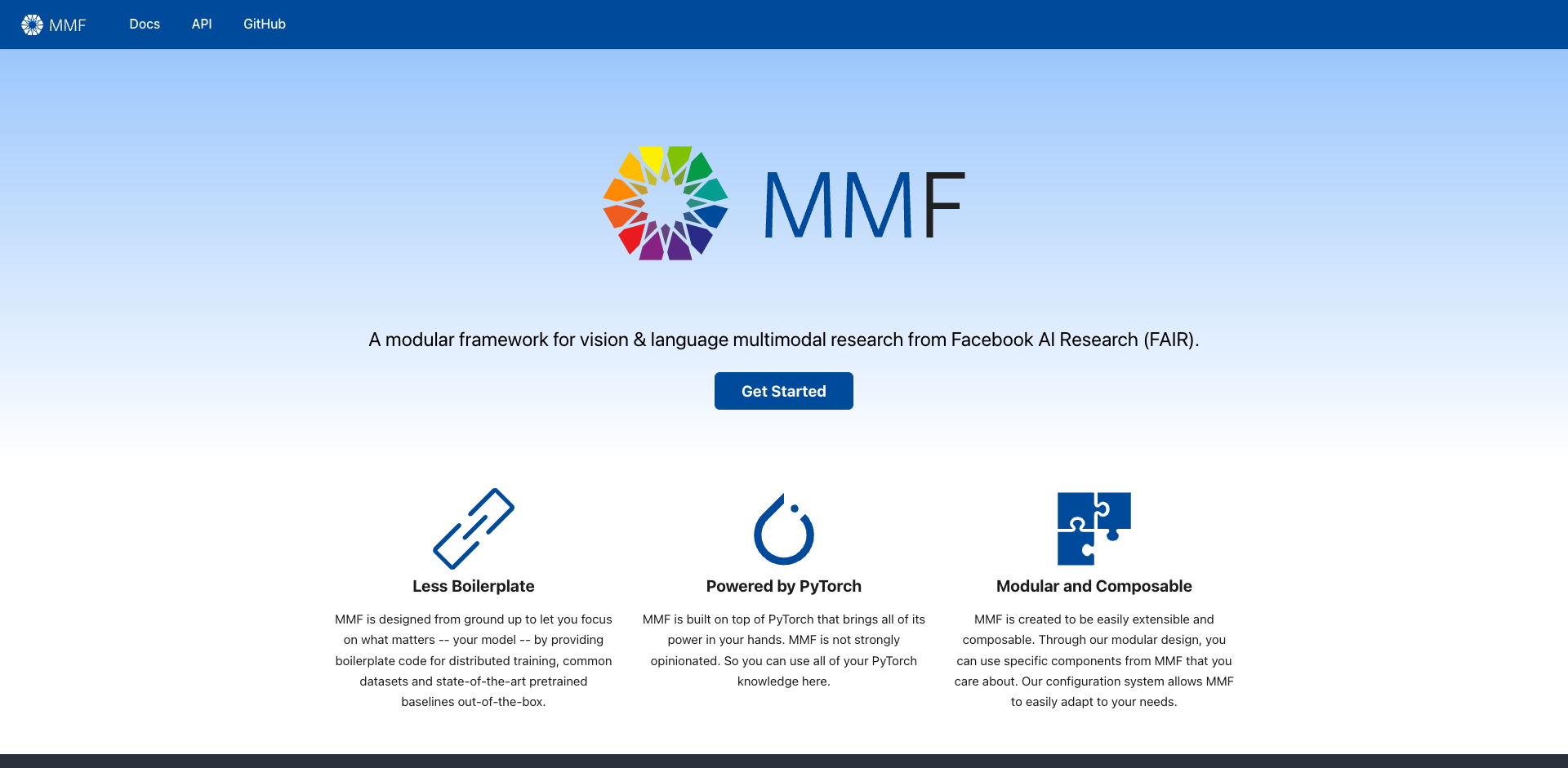

MMF简介

MMF(Modular framework for Multimodal research)是Facebook AI研究院(FAIR)开发的一个用于视觉和语言多模态研究的模块化框架。它具有以下特点:

基于PyTorch构建,支持分布式训练灵活、可扩展、快速包含多个视觉语言模型的参考实现支持多个视觉语言数据集和任务MMF为研究人员提供了一个强大的工具,可以快速开展视觉语言多模态研究。无论是想复现已有模型还是开发新模型,MMF都能大大提高研究效率。

官方资源

以下是MMF的官方学习资源:

GitHub仓库 - 项目代码库,包含完整源码官方文档 - 详细的使用教程和API文档官方网站 - 项目主页,包含概述和最新动态视频教程 - MMF框架视频介绍安装教程

MMF的安装非常简单,只需几个步骤:

确保Python 3.6+和PyTorch 1.6+已安装运行 pip install mmf验证安装 mmf_cli --help更多详细安装说明请参考官方安装文档。

快速入门

安装完成后,可以按以下步骤快速上手MMF:

下载数据集 mmf_cli datasets download --dataset vqa2训练模型 mmf_cli run config=projects/vilbert/configs/vqa2/defaults.yaml评估模型 mmf_cli evaluate config=projects/vilbert/configs/vqa2/defaults.yaml更多使用说明请查看快速入门指南。

模型和数据集

MMF支持多种视觉语言模型和数据集,包括但不限于:

模型:

VilBERTVisualBERTLXMERTM4C数据集:

VQATextVQAVizWizCOCO Captions完整列表请参考官方文档。

社区资源

除了官方资源,还有一些有用的社区资源:

MMF讨论区 - 提问和交流的地方Awesome MMF - MMF相关资源汇总MMF教程合集 - 一系列Jupyter notebook教程总结

MMF是一个功能强大且易用的视觉语言研究框架。通过本文提供的各种学习资源,相信读者可以快速掌握MMF的使用,开展自己的多模态研究。如有问题欢迎在社区讨论区交流!

希望这篇资源汇总对您有所帮助!如需了解更多细节,请查阅官方文档。祝您使用MMF愉快,研究顺利!

热门资讯

-

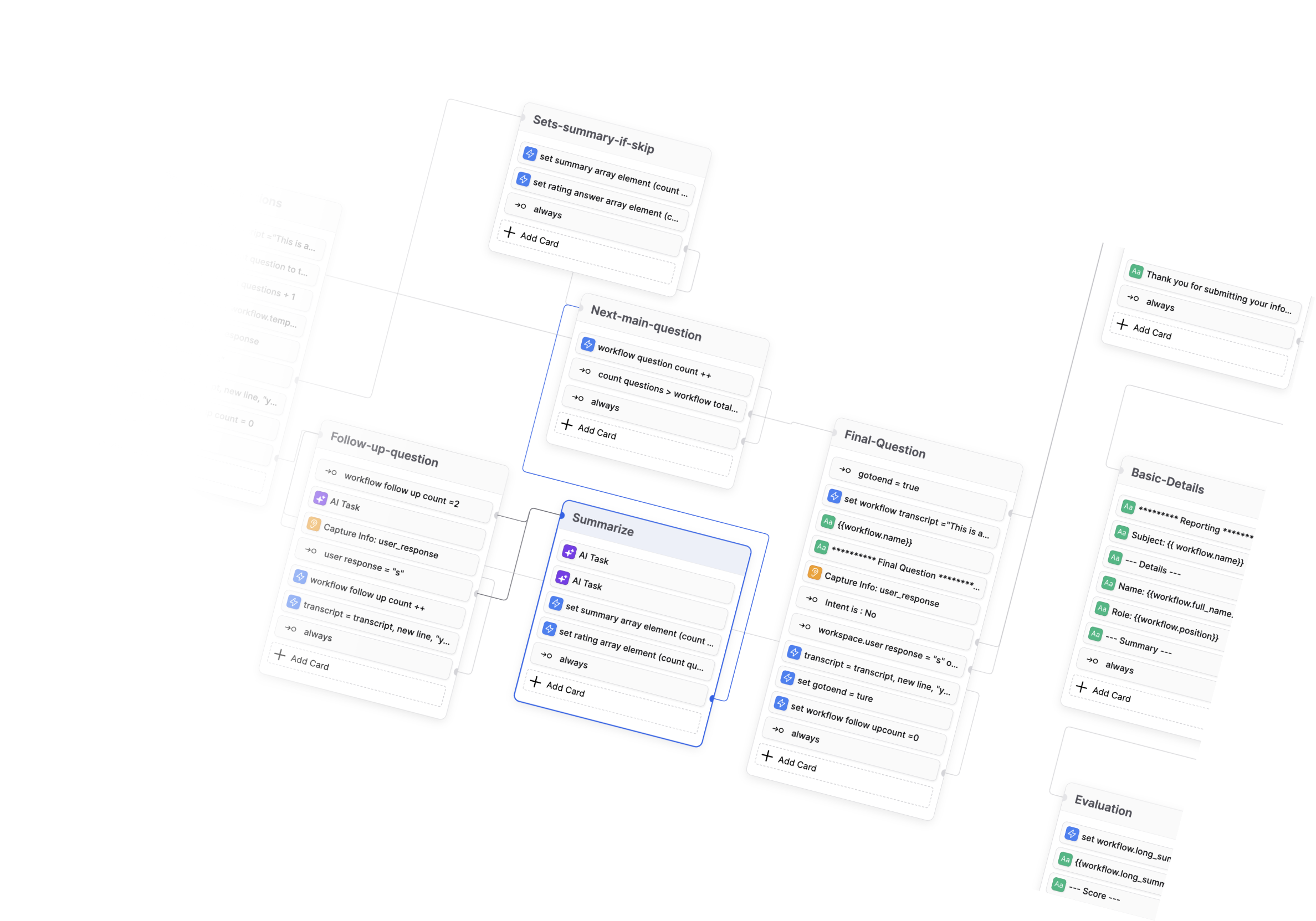

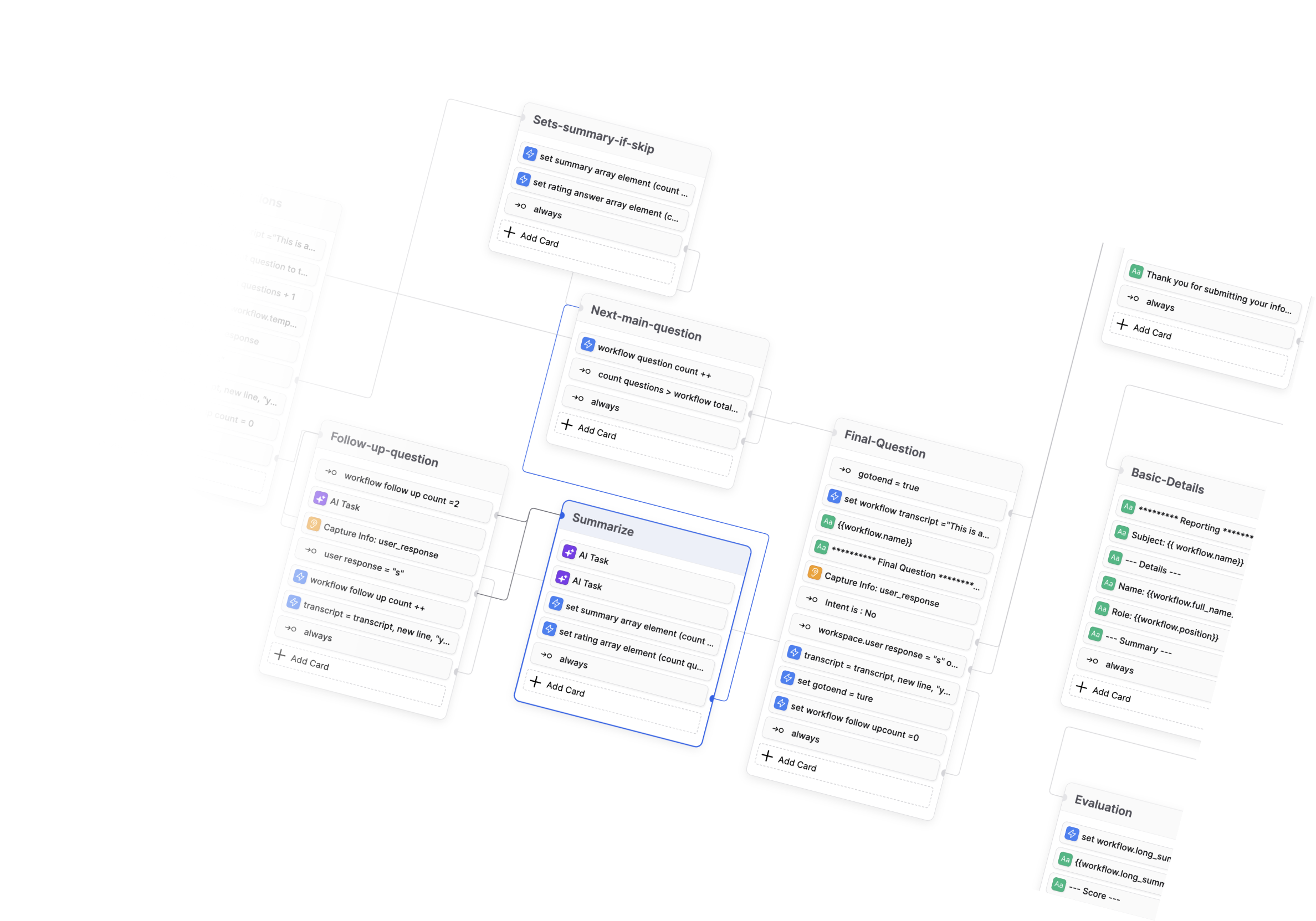

- Botpress学习资料汇总 - 开源对话式AI平台

- 994 2024-12-16 16:31:42

-

- BibiGPT-v1: 革命性的AI音视频内容一键总结工具

- 880 2024-12-19 05:49:31

-

- Ethora: 开源 Web3 社交平台引擎

- 949 2025-01-06 17:56:26

-

- DouZero: 基于自我对弈深度强化学习的斗地主AI系统

- 1043 2024-12-19 02:10:32

-

- 开源数据工程项目精选:打造现代数据基础架构

- 1002 2025-01-06 16:16:54

-

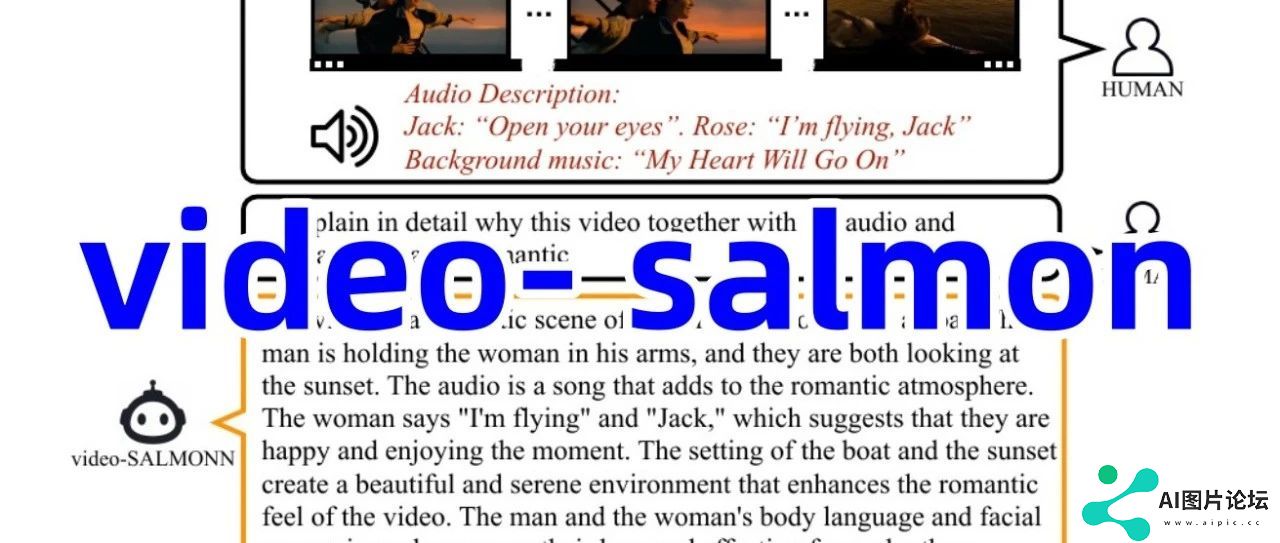

- AI也能刷短视频了?!清华大学最新发布短视频理解模型,含图像文本音频多模态理解

- 1086 2024-12-31 16:07:01

-

- Diffree:最新模型实现文字指令修改图片!!这下修图变得更简单了

- 1368 2024-12-31 16:27:01

-

- 北大团队最新发布全景3D技术!只需一张图片和一段话就能生成全景3D场景

- 1046 2024-12-31 16:46:55

-

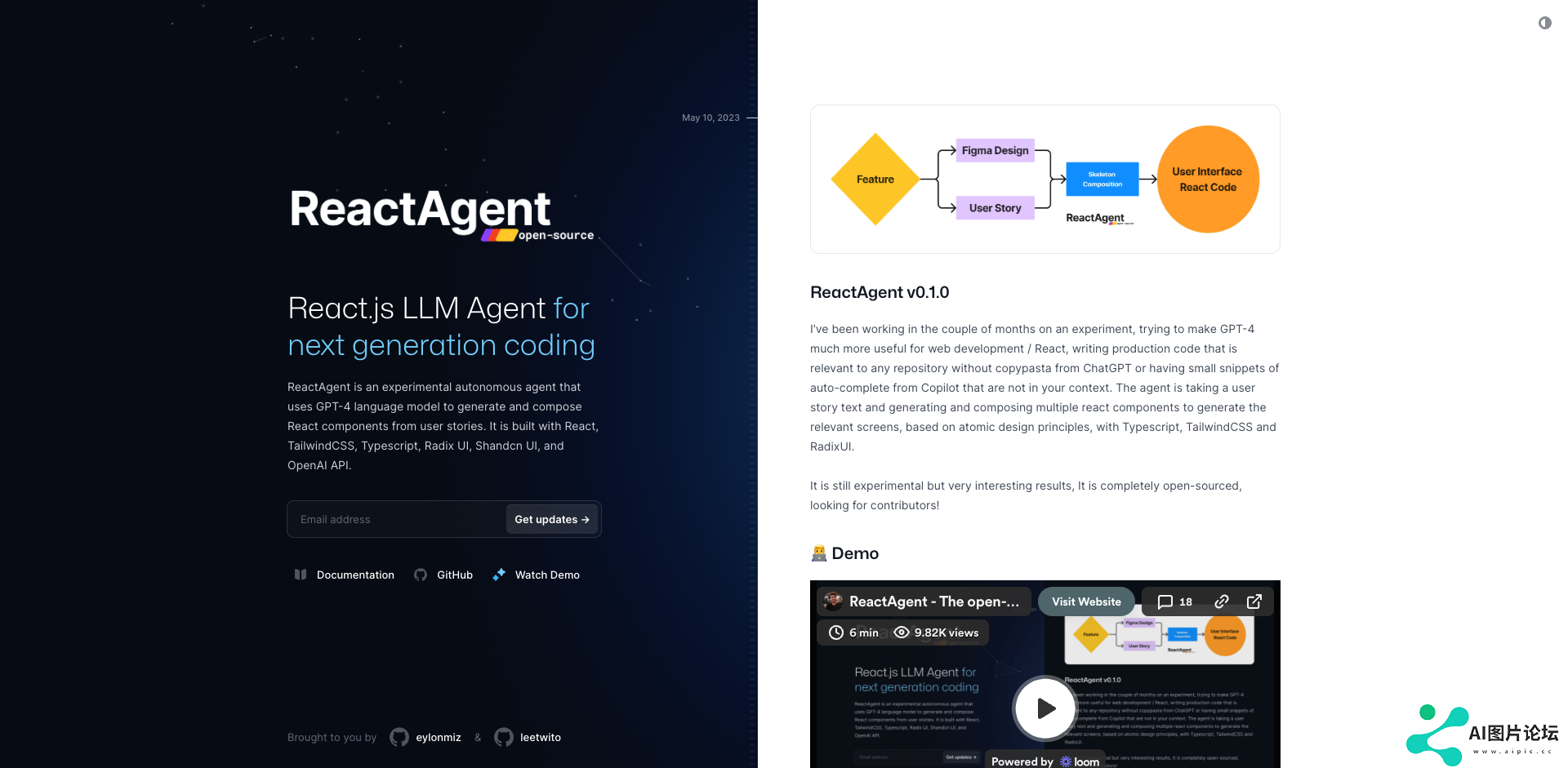

- React Agent 学习资料汇总 - 开源 React.js 自主 LLM 代理

- 982 2025-01-03 17:08:43

-

- Mojo编程语言学习资料汇总 - 兼具Python语法和系统级性能的AI编程语言

- 972 2025-01-06 14:37:19

相关常用工具

查看更多- 1 cheetah 387

- 2 SUPIR 1631

- 3 Conference-Acceptance-Rate 1584

- 4 DouZero 1575

- 5 GodMode 1498

- 6 MeloTTS 1449

- 7 codefuse 308

- 8 腾讯云 AI 代码助手 1233

- 9 CodeGeeX 1462