人工智能现在有多“像人”?

733 2025-04-20 00:00:00随着人工智能大语言模型的不断迭代,其在类人智能方面取得了不少亮眼进展——会解读心理、察言观色,进行多轮实时语音对话,甚至还掌握了人类的欺骗、奉承等手段……这是否意味着我们距离实现通用人工智能已不再遥远?当人工智能“进化”得“更像人”,又会给人类社会带来哪些潜在风险?

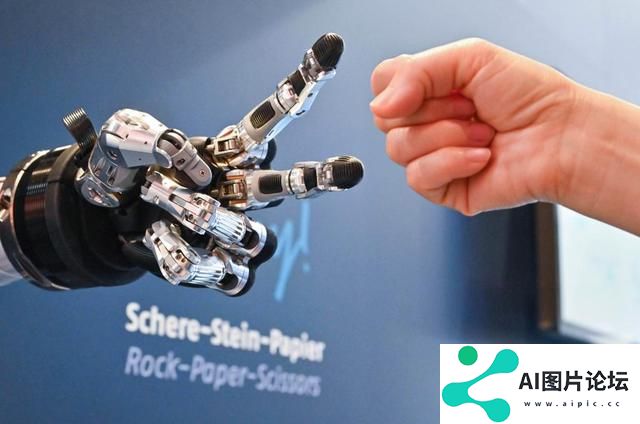

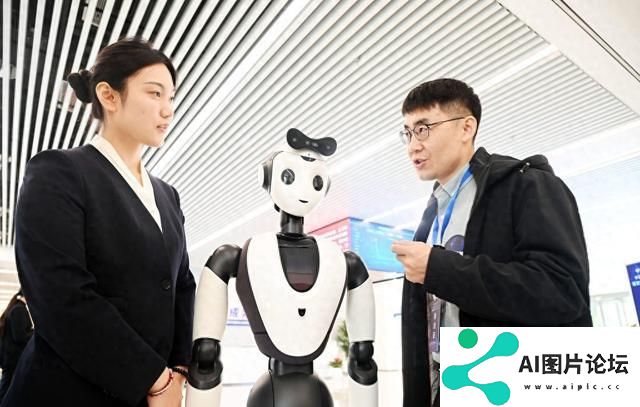

4月23日,在德国汉诺威工博会上,参观者与一款智能机器人进行“石头剪子布”游戏。新华社记者任鹏飞摄

研究人员认为,“目前不可能训练出一个在所有可能的情况下,都不能实施欺骗的人工智能模型”,进而警示如果人工智能继续完善这套技能,人类可能会失去对它们的控制。因此建议尽可能用更多时间为未来人工智能产品和开源模型的更高级欺骗做好准备。

通用智能,尚未实现

尽管人工智能已在一些方面“进化”得十分像人,但相关专家指出,对大模型的“类人智能”需要有更清醒认知。目前距离实现完全类人、具备泛化能力的通用人工智能还有一定距离。

中国科学技术大学机器人实验室主任陈小平接受新华社记者采访时指出,要警惕人类对大模型产生“幻觉”。大模型学习大量历史数据,输出的表达方式符合许多人的语言习惯,让许多人误以为大模型会“说人话”或“理解人”,继而以为它具有某种“社会属性”,但实际上它没有心智。

“人工智能的内部工作原理与人类智能不同,但在某些局部是类似的。如果认为人工智能和人类智能相同,差别只在硬件载体的不同,就会做出很多不切实际的判断。”他说,目前对大模型测评的方法,基本上仍是传统软件的测评方法,因此需对这种方法得出的测评结果保持适度的审视态度。

汉堡-埃彭多夫大学医学中心的研究人员认为,大语言模型在“心智理论”涉及能力的测试中表现与人类相当,并非表明它们具有等同于人类的能力,也不意味着它们拥有人类“心智”。他们建议,未来研究可关注大语言模型在心理推理中的表现将如何影响人类个体在人机交互中的认知。

这是2023年7月在上海举行世界人工智能大会的开幕式现场。新华社记者方喆摄

美国斯坦福大学计算机科学系教授李飞飞日前也在美国《时代》周刊刊文称,在通往通用智能的道路上,“感觉”是至关重要的一步,即拥有主观体验的能力。目前大模型并没有像人类一样的“感觉”,它可以说“自己脚趾痛”,尽管它根本就没有脚趾,它只是一个编码在硅芯片上的数学模型。

“我们还没有实现有感觉的人工智能,而更大的语言模型也无法实现这一目标。如果想在人工智能系统中重现这一现象,就需要更好理解感觉是如何在拥有实体的生物系统中产生的。”她说。

热门资讯

-

- 如何找到AI与行业的结合点:企业老板的实用指南

- 1685 2025-03-27 15:05:37

-

- AI会不会取代媒体?2024中国新媒体大会这场论坛,或许能找到答案

- 505 2025-04-05 16:05:30

-

- WrenAI学习资料汇总-开源SQL AI代理让Text-to-SQL变简单

- 1160 2025-01-03 17:48:35

-

- 动漫如何数字化转型?这些最新AI技术告诉你

- 1305 2025-04-05 17:40:39

-

- DouZero: 基于自我对弈深度强化学习的斗地主AI系统

- 1126 2024-12-19 02:10:32

-

- “画像师”大战AI,人类情感与创造力的不可替代性

- 1239 2025-01-27 10:08:39

-

- 雄安发布人工智能产业图谱及8项需求场景

- 1131 2025-02-10 13:47:59

-

- 省政府举行人工智能专题学习会 施小琳出席

- 590 2025-02-14 17:31:29

-

- 陈德院士:人工智能驱动为过程工业提供强大、可扩展的框架

- 1410 2025-02-26 13:03:59

-

- 视障人士“牵手”人工智能 信息技术发展提供更多元就业

- 1511 2025-04-05 16:32:46

相关常用工具

查看更多- 1 Okaaaay 780

- 2 GrammarGPT 285

- 3 unbounce 1750

- 4 论文智匠 744

- 5 WiziShop 1288

- 6 Easy-Peasy.AI 1801

- 7 Botowski 699

- 8 Shakespeare AI Toolbar 239

- 9 nichess 1547